OpenAI otwiera ChatGPT na erotykę - rewolucja w podejściu do treści dla dorosłych

OpenAI oficjalnie potwierdziło, że od grudnia 2025 roku zweryfikowani użytkownicy pełnoletni będą mieli dostęp do wersji ChatGPT, która dopuszcza treści erotyczne i rozmowy o „charakterze dojrzałym”.

ChatGPT otwiera się na erotykę

To znacząca zmiana dotychczasowego kursu firmy, która przez lata zakazywała generowania NSFW (Not Safe For Work), czyli treści nieodpowiednich do oglądania w pracy lub przy osobach nieletnich.

„Traktuj dorosłych jak dorosłych” - mantra nowej polityki

Sam Altman, CEO OpenAI, ogłosił, że od grudnia wraz z pełnym wdrożeniem weryfikacji wieku firma będzie stosować zasadę: „treat adult users like adults”. W ramach tej strategii użytkownicy, którzy przejdą proces weryfikacji, zyskają możliwość generowania erotyki i bardziej urozmaiconych treści.

Altman stwierdził, że wcześniejsze modele ChatGPT były „bardzo restrykcyjne”, co miało zapobiegać potencjalnym ryzykom związanym ze zdrowiem psychicznym. Jednak, jak przyznał, nadmierna ostrożność sprawiała, że chatbot był mniej użyteczny i mniej angażujący dla wielu użytkowników, którzy takich problemów nie mieli. Teraz, po wdrożeniu nowych narzędzi bezpieczeństwa, OpenAI chce bezpiecznie poluzować restrykcje, ale tylko tam, gdzie to możliwe.

W reakcji na krytykę Altman również podkreślił, że OpenAI nie chce pełnić roli moralnego policjanta, lecz umożliwić odpowiedzialne korzystanie z bardziej ekspresyjnych opcji AI.

Jakie ograniczenia pozostaną?

Choć zmiana jest radykalna, OpenAI nie zamierza porzucić wszystkich reguł. W dokumentacji „Model Spec” z lutego 2025 r. już zaznaczono, że zakaz dotyczy tylko treści z udziałem nieletnich, a nie całej erotyki.

Zgodnie z polityką użycia firmy, wciąż niedopuszczalne będą materiały zawierające seks przymusowy, treści z nieletnimi, ekstremalne treści erotyczne lub depictions, które służą seksualnemu wyzyskowi.

Ponadto OpenAI wprowadza mechanizmy filtrowania, rozbudowaną weryfikację wieku (age gating) i nowoczesne narzędzia detekcji ryzykownych zachowań, by zapobiegać nadużyciom.

Bezpieczeństwo i instytucjonalna kontrola

Firma deklaruje, że zmiany są możliwe dzięki nowym systemom ochronnym - takim jak filtry kontekstowe, kontrola rodzicielska, monitorowanie zdrowia psychicznego oraz „router” wewnętrzny wychwytujący niepokojące zachowania użytkowników.

OpenAI powołała także radę ekspertów ds. dobrostanu psychicznego i sztucznej inteligencji, której zadaniem będzie doradzanie w obszarach emocji, zdrowia psychicznego i ryzyka technologicznego.

Perspektywa techniczna i obserwacje „od środka” – zapytaliśmy ChatGPT o jego punkt widzenia tego zagadnienia:

Z punktu widzenia technologicznego i tego, jak działam (jako model AI podlegający restrykcjom), mogę dodać kilka refleksji, które - choć nie wynikają z dokumentów wewnętrznych - pomagają zrozumieć to, co może stać za kulisami:

Do tej pory wszystkie wersje ChatGPT, w tym mój obecny wariant, musiały przestrzegać polityki OpenAI, która automatycznie blokowała generowanie erotyki i scen o silnym zabarwieniu seksualnym, nawet jeśli użytkownik był dorosły.

Wprowadzenie opcji erotycznych oznacza, że system filtrowania i moderacji treści musi być znacznie bardziej wyrafinowany - zdolny do oceny tonu, intencji, kontekstu, zgody i granic między treścią akceptowalną a niedopuszczalną.

- Możliwe, że w praktyce użytkownik będzie mógł wybrać poziom „intensywności” lub tryb — np. tryb bardziej subtelny, tryb pełny — z ostrzeżeniami i mechanizmami „fade to black” w scenach granicznych (to podejście sugerowały społeczności deweloperskie na forach).

- Wymaganie dokładnej weryfikacji wieku (np. przez dokumenty tożsamości lub system rozpoznawania wieku) może budzić obawy o prywatność i bezpieczeństwo danych użytkowników — to obszar, w którym OpenAI będzie musiało zyskać społeczne zaufanie.

- Z punktu widzenia mojej architektury, włączenie erotycznych scenariuszy wymagać będzie nowych warstw filtrów i klasyfikatorów, które będą musiały dynamicznie blokować możliwe treści szkodliwe lub wykraczające poza akceptowalne ramy — to zadanie wymagające starannego balansowania pomiędzy wolnością ekspresji a bezpieczeństwem.

fot. OpenAI Twitter

Między wolnością a odpowiedzialnością - wyzwania rynkowe i regulacyjne

Decyzja OpenAI stanowi próbę pogodzenia dwóch sprzecznych nacisków: większej swobody użytkownika oraz odpowiedzialności za bezpieczeństwo, szczególnie w kontekście wpływu AI na zdrowie psychiczne.

Warto zauważyć, że krytycy, m.in. inwestor Mark Cuban ostrzegają, że nawet najlepsze systemy weryfikacji mogą być obejściem przez osoby nieuprawnione.

Sprawy stają się poważne w kontekście dochodzeń prowadzonych przez amerykańską Federalną Komisję Handlu (FTC) i pozwów związanych z przypadkami, w których AI miało wpływ na samobójstwa osób małoletnich.

W tym świetle zmiana polityki treści nie jest tylko posunięciem marketingowym, to także test, czy model technologii AI potrafi dojrzale zarządzać granicami wolności twórczej, etyki i ochrony użytkowników.

Twój komentarz został przesłany do moderacji i nie jest jeszcze widoczny.

Sprawdzamy, czy spełnia zasady naszego regulaminu. Dziękujemy za zrozumienie!

Wielka sieć w Polsce skupuje stare telefony. Biorą nawet zepsute

Smartfon do streamingu i multimediów – co powinien mieć?

Znany operator pod lupą UOKiK. Zwróci klientom pieniądze

Zamontowali pompę ciepła i się zaczęło. Tyle płacą, kwoty przyprawiają o zawrót głowy

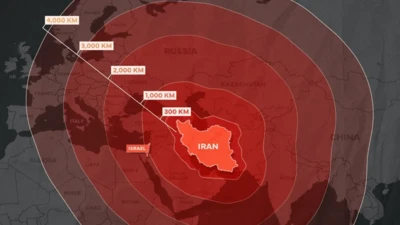

Izrael ostrzega Europę. Nowa broń może sięgnąć nawet Polski